Selon Fortune Business Insights, le marché de l’analyse dépasse 200 milliards d’euros en 2024. Les entreprises affrontent des flux d’informations massifs et complexes. Choisir l’outil adapté n’est plus une option mais une nécessité technique. Une plateforme performante transforme des données brutes en leviers décisionnels concrets. La sélection repose sur des critères stricts comme la scalabilité ou la sécurité. Ce guide technique détaille les fonctionnalités indispensables pour votre infrastructure.

Maîtrisez la Croissance Exponentielle de vos Données

La scalabilité demeure indispensable. Votre infrastructure doit supporter une charge croissante sans latence. Cette capacité assure un traitement fluide des Big Data.

Analysez la Vitesse de Traitement des Flux

Votre architecture doit gérer deux types de flux. C’est un défi technique majeur pour la plupart des systèmes. Une plateforme performante assure une gestion hybride des modes de traitement sans aucune latence. Il faut vérifier la compatibilité avec vos besoins réels.

Les entreprises utilisent deux méthodes pour ingérer ces données. Voici les distinctions à connaître :

- Le traitement par lots (Batch) analyse de grands volumes d’historiques stockés ;

- Le flux continu (Streaming) gère les données IoT ou financières en temps réel.

Combiner ces approches offre une vision analytique complète. Elle permet de croiser l’historique avec l’instant présent pour des décisions plus justes.

Exploitez la Puissance du Calcul Distribué

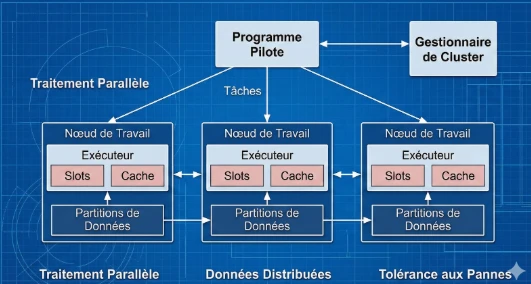

Un serveur unique sature vite face aux téraoctets de données. Il ralentit alors toute la chaîne de production. Le calcul distribué devient indispensable pour maintenir la performance. Cette technologie divise les tâches sur plusieurs machines simultanées. Apache Spark ou Dask excellent dans ce domaine.

Voici les spécificités des leaders du marché :

| Framework | Usage Recommandé | Avantage Technique Majeur |

| Apache Spark | Traitement Big Data industriel | Vitesse de calcul en mémoire (In-Memory) |

| Dask | Projets Data Science en Python | Intégration native et parallélisme flexible |

L’utilisation de ces clusters permet de réduire drastiquement les temps de calcul pour les requêtes lourdes.

Connectez l’Ensemble de vos Flux de Données

L’intelligence de l’entreprise ne tient plus dans un simple tableur. Gartner estime le coût annuel de la mauvaise qualité des données à 12,9 millions de dollars. Un outil moderne doit briser ces silos pour unifier la vue.

Harmonisez les Structures Complexes et Variées

La vraie valeur réside souvent dans les formats bruts. L’IDC confirme que 80 % des données mondiales sont désormais non structurées. Une compatibilité universelleévite tout angle mort analytique.

Les standards actuels exigent la prise en charge native des typologies suivantes :

- Les données structurées comme les fichiers CSV ou SQL ;

- Les formats semi-structurés, notamment le JSON et le XML ;

- Les flux non-structurés issus du NoSQL ou de l’IoT.

Cette polyvalence devient un atout stratégique majeur. Elle centralise l’information en un point de vérité unique.

Centraliser via les API et Bases de Données

L’interopérabilité technique ne se négocie pas. Les plateformes performantes utilisent des connecteurs natifs pour votre écosystème. L’intégration directe élimine les passerelles manuelles coûteuses et fragiles. L’automatisation API garantit la mise à jour des tableaux. Elle fournit aux décideurs des données fraîches et synchronisées. C’est vital pour une réactivité opérationnelle maximale.

Puissance Analytique et Modélisation Avancée

L’analyse ne se limite plus au simple rétroviseur. Les entreprises exigent désormais des capacités prédictives pointues. Votre infrastructure doit supporter cette évolution sans faiblir.

Déployez les Niveaux d’Investigation

La finalité est de transformer des statistiques froides en plans d’action rentables. Cette conversion exige une plateforme capable de creuser profondément dans les bases de données complexes. Dénicher une tendance lucrative peut sembler aussi aléatoire qu’un gain sur Lucky Treasure sans une assistance technique adéquate. Mais une entreprise sérieuse ne peut pas baser sa stratégie sur le simple hasard. Il faut rationaliser cette recherche de profit par des méthodes éprouvées.

Une suite logicielle complète doit couvrir ces quatre étapes chronologiques :

- L’analyse descriptive. Elle résume ce qui s’est passé historiquement grâce à l’agrégation des données brutes.

- L’analyse diagnostique. Elle explique pourquoi un événement a eu lieu en isolant les anomalies et les corrélations.

- L’analyse prédictive. Elle utilise des probabilités statistiques pour anticiper les scénarios futurs probables.

- L’analyse prescriptive. Elle suggère des actions concrètes pour optimiser les résultats futurs.

Cette gradation permet de passer de la simple information à l’action concrète. Elle transforme le département IT en véritable centre de profit.

Intégrez les Langages de Modélisation

L’interface graphique suffit rarement aux calculs complexes. Une infrastructure performante supporte l’exécution de scripts sur mesure. C’est indispensable pour intégrer le Machine Learning avancé.

Voici les environnements techniques standards que votre outil doit accepter :

| Langage / Outil | Spécialisation Technique | Librairies Clés |

| Python | Polyvalence et Production | Pandas, Scikit-learn |

| R | Statistiques Pures | Ggplot2, Dplyr |

| MATLAB | Ingénierie et Mathématiques | Simulink |

Cette compatibilité technique ouvre la porte à une personnalisation infinie des modèles d’analyse. Elle permet aux Data Scientists de travailler avec leurs outils de prédilection sans friction.

Visualisation Interactive et Reporting Automatisé

La donnée brute reste illisible pour la majorité des décideurs. Il faut traduire ces lignes de codes en graphiques clairs. Une bonne plateforme rend l’information stratégique accessible à tous les départements. Des solutions comme Tableau, Power BI et Plotly dominent le marché. Elles offrent une clarté visuelle immédiate pour identifier les tendances.

Votre choix doit se porter sur une interface avec ces options clés :

- Tableaux de bord dynamiques qui se mettent à jour en temps réel sans intervention humaine ;

- Graphiques interactifs (Drill-down) permettant de cliquer sur un élément pour voir le détail sous-jacent ;

- Reporting automatisé pour envoyer des rapports PDF ou emails programmés aux parties prenantes.

Ces outils changent une base technique en support de communication visuelle. Ils alignent tout le monde sur la même vision de la performance.

Automatisation des Flux et Intégration CI/CD

L’automatisation supprime les tâches manuelles répétitives et les risques d’erreurs humaines. Les meilleurs outils exécutent les processus ETL et les tâches par lots de manière autonome. Cela libère du temps précieux pour l’analyse stratégique pure.

L’intégration connecte Git et Jenkins aux services cloud comme AWS ou Azure. Des API robustes exécutent vos scripts Python, R ou SQL. Cette méthode garantit une analyse fiable à chaque nouveau déploiement.

Sécurité Maximale et Conformité Réglementaire

La protection des données sensibles ne tolère aucune faille. Votre infrastructure doit garantir un chiffrement militaire et un accès strict. Le respect du RGPD ou HIPAA est une obligation légale absolue. IBM évalue le coût moyen d’une fuite de données à 4,45 millions de dollars.

Voici les références du secteur pour la gouvernance des données :

| Outil | Force Sécuritaire | Secteur de Prédilection |

| SAS | Sécurité de classe entreprise | Banque et Assurance |

| Alteryx | Gouvernance centralisée | Finance et Retail |

| Databricks | Sécurité unifiée des données | Tech et Industrie |

Ces plateformes offrent une traçabilité complète des actions. Elles protègent l’entreprise contre les risques juridiques et les cyberattaques.

Support Actif et Écosystème Extensible

Un outil isolé devient vite un frein technique. Une aide rapide est cruciale pour maintenir la production. Des écosystèmes comme Python ou Power BI simplifient le dépannage. L’expérience partagée offre des solutions immédiates.

Une communauté active offre des ressources inestimables pour vos équipes :

- Une documentation riche et à jour pour résoudre les blocages techniques ;

- Des plugins et bibliothèques open-source pour étendre les fonctionnalités ;

- Un réseau mondial d’experts pour partager les meilleures pratiques de codage.

Cette extensibilité assure la longévité de votre solution face aux évolutions technologiques futures.

Conclusion

Au final, le choix de votre outil détermine votre futur analytique. Il ne faut négliger aucun des 7 piliers techniques présentés, de la scalabilité du volume à la sécurité des accès. Une infrastructure bien sélectionnée convertit vos données brutes en croissance durable. C’est le socle indispensable de votre réussite numérique.