Pratique et intuitif, Jupyter Notebook peut vite tourner au chaos s’il est mal dompté. Mais avec un peu de méthode, il devient un véritable couteau suisse pour les Data Scientists : labo d’expérimentation, carnet de bord, tableau de visualisation… le tout concentré dans une seule interface. Dans cet article, on vous partage les meilleures astuces pour transformer vos notebooks en documents clairs et élégants !

C’est devenu un réflexe pour des milliers de Data Scientists : ouvrir un Jupyter Notebook pour tester un modèle, explorer un jeu de données, ou rédiger une démonstration rapide.

Malheureusement, ce qui devait être un carnet lisible et structuré devient souvent une jungle de cellules éparpillées, de variables orphelines et de visualisations mal calibrées. Résultat : le notebook est inutilisable… même pour soi-même, une semaine plus tard.

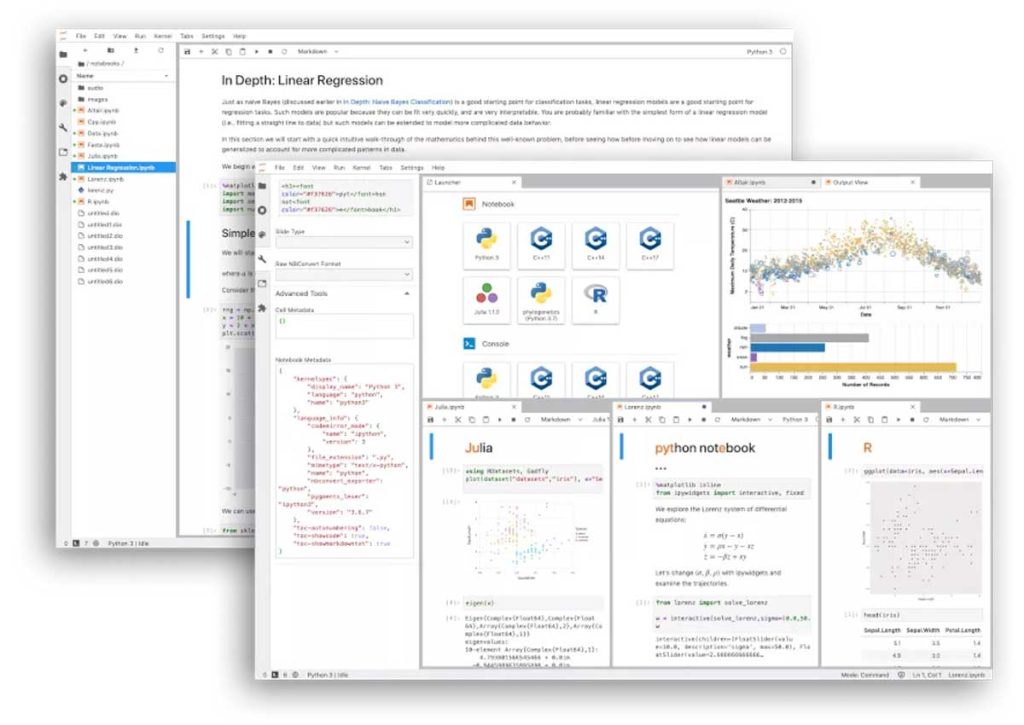

Pourtant, Jupyter Notebook est bien plus qu’un bac à sable. Lorsqu’il est utilisé de la bonne façon, il se transforme en un véritable atelier de Data Science : lisible, collaboratif, modulaire, et parfois même reproductible.

Ainsi, maîtriser l’installation et l’utilisation de Jupyter Notebook est primordial. Quelles sont les meilleures pratiques pour exploiter toute sa puissance ? C’est ce que vous allez découvrir !

Structurer son notebook comme un projet, pas comme un brouillon

Oubliez l’image du notebook « jetable » dans lequel on copie-colle du code à la volée. Si Jupyter est pensé pour l’exploration rapide, c’est aussi un outil redoutable pour documenter une démarche, tester proprement une hypothèse ou formaliser un pipeline de traitement.

À condition, bien sûr, de ne pas tomber dans l’improvisation permanente. La première règle, trop souvent négligée, c’est d’organiser son notebook avec des titres clairs, hiérarchisés et narratifs.

Grâce au Markdown, chaque section peut être balisée pour créer une structure logique. Ça ne prend que quelques secondes, et ça change tout : on comprend instantanément ce que fait chaque bloc, et on peut s’y retrouver rapidement.

Un autre point important est de grouper les imports et paramètres en début de document. Il est tentant d’importer ses bibliothèques au fil de l’eau, au gré des besoins, mais c’est une mauvaise idée.

Centraliser tous ses imports au début du notebook, avec une cellule dédiée, permet non seulement de mieux gérer les dépendances, mais aussi de faciliter la relecture ou la réutilisation du code.

Idem pour les variables globales : un bloc bien identifié, bien commenté, et vous gagnez en lisibilité dès la première cellule.

En outre, l’un des pièges classiques avec Jupyter, c’est l’exécution dans le désordre. Une variable dans une cellule oubliée, un blob exécuté trop tôt, et c’est le drame.

L’idéal, c’est de penser son notebook comme un script exécutable de haut en bas. Et pour ça, il faut anticiper la logique du code, éviter les effets de bord, et régulièrement utiliser « Restart & Run All » pour s’assurer que tout tourne sans accroc.

Un bon notebook, c’est un notebook qu’on peut lire comme une histoire, rejouer comme un programme, et comprendre comme un raisonnement.

Faire parler son code : commentaires, visualisation et storytelling

Un bon notebook ne se contente pas de faire tourner du code. Il raconte quelque chose. Il explique pourquoi telle transformation est effectuée, ce qu’on observe dans un graphique, ou ce qu’on compte tester ensuite. Il guide le lecteur.

Les commentaires techniques sont utiles, mais ils ne suffisent pas. Ce qui fait la différence, ce sont les cellules Markdown où vous expliquez vos choix, vos hypothèses, vos doutes.

Pourquoi ce modèle plutôt qu’un autre ? Que signifient ces résultats intermédiaires ? Quels biais potentiels ? Ces éléments sont souvent absents, alors qu’ils constituent l’âme d’un bon notebook.

Pensez-le comme un journal de bord scientifique. Il ne s’agit pas d’écrire un roman, mais de poser quelques phrases qui éclairent le cheminement.

Autre atout puissant : la visualisation. Trop souvent utilisée uniquement à la fin du projet, elle peut être redoutablement efficace dès la phase d’exploration.

Un « sns.pairplot() » ou un « df.plot() » bien placé peut faire apparaître des tendances, des valeurs aberrantes ou des patterns inattendus.

Et tant qu’à visualiser, autant le faire bien : titres lisibles, axes nommés, légendes claires. Ce ne sont pas des détails. C’est ce qui permet à vos interlocuteurs de comprendre en un clin d’œil ! La forme rend le fond accessible.

Si vous travaillez en équipe, ou si vous reprenez un ancien projet, un notebook bien commenté et illustré devient un document de transmission.

Gérer les imports, les chemins et les variables comme en prod

Le piège classique du notebook « à l’arrache », c’est de coder comme si tout allait rester dans ce fichier unique, sur une seule machine, sans jamais évoluer.

C’est oublier que les notebooks font partie d’un projet plus large, et qu’ils doivent pouvoir être rejoués, versionnés, ou exportés.

Oui, vous êtes en mode exploration. Non, ce n’est pas une raison pour importer pandas dans trois cellules différentes.

Regroupez tous vos imports en début de documents, avec des commentaires clairs. Vous pouvez même séparer les bibliothèques « standard », « data » et « visualisation » pour y voir plus clair.

Et pour aller plus loin, testez l’extension « %autoreload » de IPython : elle permet de mettre à jour automatiquement vos modules Python sans redémarrer le kernel. Un gain de temps énorme quand on modifie ses fonctions dans un autre fichier .py !

Par ailleurs, les chemins relatifs en dur sont un cauchemar dès qu’on change d’environnement. Avec pathlib, vous pouvez construire des chemins dynamiquement, en fonction de la structure du projet. C’est plus lisible, plus robuste et compatible tous OS.

Vous l’aurez compris : Jupyter Notebook, c’est comme un carnet de recherche numérique. Ce n’est pas juste un outil de test : c’est un support d’explication, de visualisation, de transmission.

Un bon notebook ne montre pas seulement ce que vous avez fait. Il explique pourquoi vous l’avez fait, et comment on peut le refaire.

En appliquant ces bonnes pratiques, vous transformez un simple environnement interactif en un véritable outil de pensée structurée, prêt à s’intégrer dans un vrai projet data. Et c’est bien là que Jupyter révèle tout son potentiel : entre le code, le récit et la collaboration…